Signalverarbeitung

Wie werden die IR-Detektoren ausgelesen? Welchen Einfluss haben diese Verfahren auf das Messergebnis (also für des resultierende Wärmebild) und auf die Bildwiederholrate?

Das von einem IR-Detektor bereitgestellte Strahlungsintensität-Analogsignal muss bei radiometrischen Wärmebildkameras zwingend digitalisiert werden, um mittels der „Pyrometrischen Grundgleichung“ eine Berechnung der Objekttemperatur durchführen zu können. Je nach verwendetem Sensortyp gibt es hierfür verschiedene Auslesemethoden, die einen bedeutenden Einfluss auf das Messergebnis und damit die Anwendbarkeit der Wärmebildkamera haben.

Ich erkläre Dir also hier die einzelnen Verfahren und erkläre deren Unterschiede an konkreten Beispielen.

Grundlegende Ausleseverfahren

Ein wichtiger Aspekt bei der Auswahl der Sensortechnologie ist, wie schnell die Messung durchgeführt werden soll, d.h. wie kurz die Integrationszeit (oder wie hoch die Bildwiederholrate sein muss). Während die schnellsten Mikrobolometer mit Integrationszeiten unter 7 ms keine akzeptable thermische Auflösung mehr erreichen, können Photonendetektoren dies in weniger als 1/10 ms (sogar unter 1 μs).

Willst du sich bewegende oder rotierende Objekte oder bei Bewegung der Kamera relativ zum Objekt messen, hängt die Anwendbarkeit des thermografischen Systems aber nicht nur von der mit dem Detektortyp erreichbaren Bildwiederholrate ab, sondern auch vom Pixeldaten-Ausleseverfahren. Es gibt hierfür zwei Lösungen: das zeilenweise Auslesen (für alle Detektortypen geeignet) und das sogenannte „Snap-Shot”-Verfahren. Letzteres basiert ausschließlich auf den spezifischen Eigenschaften schneller Photonendetektoren, da die große Zeitkonstante thermischer Detektoren (z.B. Mikrobolometer) den Einsatz dieser Technologie völlig zwecklos macht.

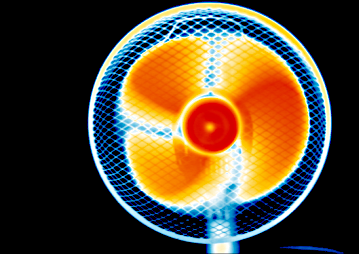

Beispielsweise besteht ein Matrixdetektor mit 320×240 Pixel aus 78600 Einzeldetektoren. Zwecks Verringerung des Raum- und Energiebedarfs (sowie der Kosten) wird nicht jeder Einzeldetektor mit einem eigenem Ausleseschaltkreis und A/D-Wandler versehen, um deren analoge Ausgangssignale zu digitalisieren. Statt dessen werden nur 240 Ausleseschaltungen – also für eine komplette Zeile – genutzt, mit denen durch 320 zeilenweise Auslesungen nacheinander alle Pixel der Matrix erfasst werden.

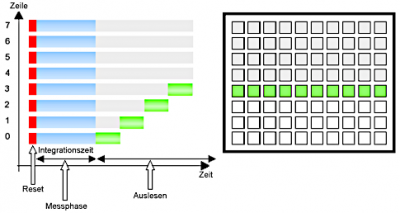

Hierfür wird zuerst die erste Zeile auf Null gesetzt und deren Integration neu gestartet, dann ein wenig später die zweite, dritte und die nachfolgenden Zeilen. Zwischenzeitlich läuft die Integrationszeit der ersten Zeile ab, so dass diese ausgelesen werden kann. Hiernach folgt dann die Auslesung der weiteren Zeilen, während die erste Zeile (und in Folge dann auch die übrigen) nach der jeweiligen Nullsetzung bereits erneut integriert. Dieser Kreisprozess kann auch als eine fortlaufende Integration aller Zeilen beschrieben werden, welche zyklisch durch zeilenweise Auslesung und Nullsetzung kurz unterbrochen wird.

(blau = Integrationszeit, grün = Auslesung)

(Abbildung © Eric Rahne)

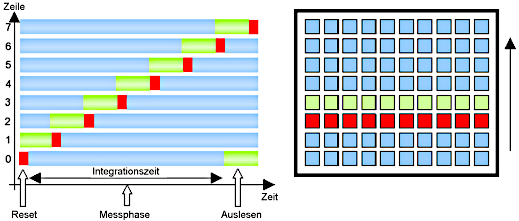

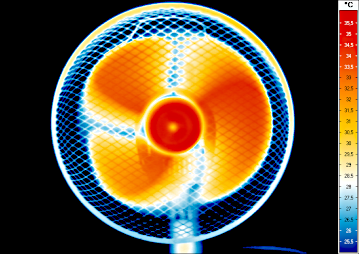

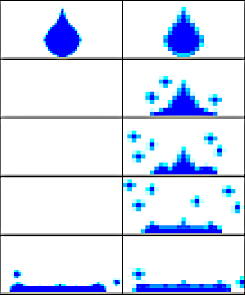

Die Folge des zeilenweisen Auslesens ist, dass sich (relativ zur Kamera) bewegende Objekte verzerrt dargestellt werden, wie in der folgenden Abbildung gezeigt. (Je schneller die Objektbewegung ist, desto höher ist die Verzerrung.) Der Grund hierfür ist die nicht zeitgleiche – sondern zeilenweise zeitversetzte – Erfassung der Einzelpixel.

(Abbildung © Eric Rahne)

(Abbildung © Eric Rahne)

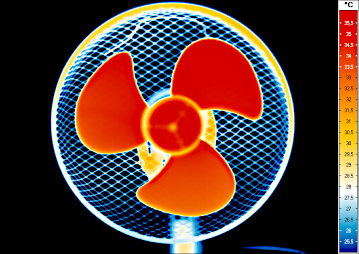

Das Problem der Erfassung sich bewegender oder rotierender Objekte kann mit der „Snap-Shot”- Technologie (Blitzlichtaufnahme) gelöst werden. Dieses simultane Aufnahmeverfahren ist jedoch nur bei schnellen Photonendetektoren (mit Integrationszeiten um 10 μs oder kürzer) sinnvoll. Thermische Detektoren (z.B. Mikrobolometer) würden wegen ihrer um mehrere Größenordnungen langsamere Integration ohnehin das sich bewegende Objekt nur verschwommen bzw. verzerrt darstellen können.

Photonensensoren mit „Snap-Shot”-Fähigkeit führen die Messung (Signalintegration) an jedem Pixel gleichzeitig (also simultan) durch, dann werden die auf den Pixeln gemessenen Werte „eingefroren”. Als nächstes wird dann das Auslesen und die A/D-Wandlung wiederum nur Zeile für Zeile ausgeführt. Also auch hier erspart man sich Tausende von Ausleseschaltkreisen und A/D-Wandlern, genauso wie bei der zeilenweisen Auslesung. Die Verzerrung der Abbildung bewegter Objekte wird aber dadurch vermieden, dass das von allen einzelnen Sensoren gemessene Signal von demselben Zeitpunkt stammt.

(blau = Integration, grün = Auslesung, grau = eingefrorener Wert, weis = bereits ausgelesen)

(Abbildung © Eric Rahne)

(Abbildung © Eric Rahne)

Erhöhung der Bildwiederholrate

Moderne Photonendetektor-Thermokameras mit „Snap-Shot”-Technologie können bereits sogar über tausend Thermogramme mit einer Auflösung von 640×512 Pixel pro Sekunde (im Vollbild-Modus) aufnehmen, dabei natürlich alle Pixel simultan erfassend. Es ist jedoch am obigen Zeitdiagramm erkennbar, dass die Gesamtauslesezeit durchaus mit der Integrationszeit vergleichbar ist oder diese sogar überschreitet. Die maximale Bildrate ist daher in erster Linie durch die Auslesezeit begrenzt.

Zur Lösung dieses Problemes werden folgende Verfahren angewandt (je nach den Fähigkeiten des in der Wärmebildkamera verbauten Photonendetektors).

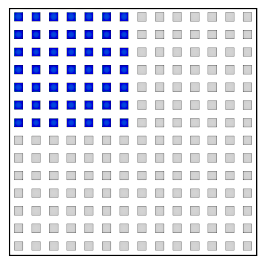

Um eine noch schnellere Bilderfassung zu erreichen, werden statt der Gesamtmatrix nur Teilbilder (sogenannte SubFrame) ausgelesen, was weniger Zeit benötigt. Leider bedeutet dies aber auch, dass nun weniger Details (weniger Pixel) angezeigt werden. Thermokameras mit dieser Teilbild-Technologie können beispielsweise – im Vergleich zum Vollbildmodus – ca. 4-mal so viele Thermogramme im Viertelbildmodus aufnehmen.

Der Detektor integriert natürlich auch weiterhin auf allen Pixeln gleichzeitig und friert auch alle Daten ein. Es wurde durch das Teilbild nur das Auslesen und die Digitalisierung auf den gewählten Bereich begrenzt und damit die Bildwiederholrate erhöht. Nachteilig ist die Bildfeldbegrenzung und damit die nur teilweise Ausnutzung der Detektorpixel: im Viertelbildmodus nur 25% aller Pixel des Detektors.

(Abbildung © Eric Rahne)

Binning ist das Zusammenschalten benachbarter Detektorpixel auf der Hardware-Ebene (also nicht nachträglich per Software) zu „Großpixeln” (oder virtuellen Pixeln), wodurch eine höhere Empfindlichkeit, eine bessere thermische Auflösung und gleichzeitig eine schnellere Bildwiederholrate erreicht werden können. Nachteilig ist hierbei, dass sich die Gesamtzahl der entstehenden Messpixel entsprechend der jeweils zusammengefassten Pixelanzahl gegenüber der nativen Detektorpixelauflösung reduziert, d.h. die Pixelauflösung des Ergebnisthermogramms sowie die geometrische Auflösung des Messsystems nimmt proportional ab. (Das Sichtfeld ändert sich dagegen nicht.)

(Abbildung © Eric Rahne)

Ausser der Erhöhung der Bildwiederholrate kann durch Binning gleichzeitig auch die Empfindlichkeit des Detektors verbessert werden, da die Reihenschaltung mehrere Pixel eine Aufaddierung derer Signale und damit eine proportionale Erhöhung des auswertbaren Nutzsignals mit sich bringt. Davon ausgehend, das das Rauschen statistisch verteilt ist, kann gleichzeitig mit einer Verbesserung des Signal-Rauschabstands und damit einer höheren thermischen Auflösung gerechnet werden. Letzteres kann man theoretisch durch die Parellelschaltung der Einzeldetektoren gezielt erwirken. Für beide Schaltungen gilt: Je mehr Pixel zusammengefasst werden, desto bessere Ergebnisse sind möglich – bei zunehmend höherer Bildwiederholfrequenz.

(Abbildung © Eric Rahne)

Fortsetzung

Weitere Informationen zur Gerätetechnik der Wärmebildkameras findest Du hier:

Grundlegender Aufbau

Aus welchen Hauptbestandteilen besteht eine Wärmebildkamera?

Infrarot-Detektoren

Was sind thermische Sensoren, was sind Photonendetektoren?

Objektive & Filter

Was sind die Materialien für IR-Objektive und Spektralfilter?

Bildbearbeitung

Mit welchen Verfahren und "Tricks" werden gut aussehende Wärmebilder erzeugt?

Geräteparameter

Welchen Einfluss haben die messtechnischen Parameter auf die Anwendbarkeit?

Kalibration

Wie und womit werden Wärmebildkameras kalibriert? Was ist der NUC-Abgleich?